-

PLUS

Prisvärda mobiler, Swedbank, problemlösning, Xiaomi 15 Ultra och mer – Mobil ger svar

-

PLUS

Krönika: Därför kan vi förvänta oss en ny Windows-telefon - del 2

-

PLUS

Krönika: Därför kan vi förvänta oss en ny Windows-telefon

-

PLUS

Krönika: Bra jobbat! Du har simmat 1 meter – se alla uppgifter om ditt träningspass här

-

PLUS

Airpods: 11 tips för att hitta okända funktionerna och lösa vanliga problem

-

PLUS

Googles Pixel 10-lansering på djupet

-

PLUS

Krönika: När AI behöver en ständig övervakare

-

PLUS

Långtidstest: Samsung Galaxy S25

-

PLUS

Krönika: När AI meckar med våra bilder utan att vi bett om det

-

PLUS

Allt du behöver veta om mobilens skärm

Artikelserie om Mobilljud del ett

Reportage: Vi förklarar ljud och musik i mobilen

Ljudet utgör alltjämt kärnan i mobilupplevelsen. Webb, foto och spel konkurrerar om uppmärksamheten, men samtal och musik är funktionerna vi använder mest.

Ljudet som våra öron uppfattar är vågrörelser. Svängningar i luften som genereras av alla typer av rörelser – från insektsvingar till vattenmassor och stora vädersystem. Mycket mer analogt än så blir det inte. Därför har det alltid varit en utmaning att omvandla ljud till något som går att spara eller skicka med bra kvalitet och på ett effektivt sätt – speciellt i digitala kanaler där utrymmet bara räcker för några få procent av den ursprungliga signalen.

När mobiltelefonerna började komma ned i pris under slutet av 1980-talet och början av 1990-talet blev det tydligt att de analoga systemen inte skulle hålla för en stor ökning av antalet användare. Även i de gamla fasta telefonnäten ökade antalet samtal och med start på 1960-talet började man hämta teknik från datorvärlden för att få plats med mer i kablarna. Samtalen blev digitala i de stora knutpunkterna och i så kallade trunkar – stamledningar som buntade ihop hundratals eller tusentals telefonlinjer till två koppartrådar.

Med bara två olika signaler – ettor eller nollor, spänning på eller av – blev det enklare att bygga förbindelser som klarade långa sträckor utan att informationen gick förlorad eller kvaliteten blev sämre. Att bara digitalisera räckte dock inte för att få in fler telefonlinjer i samma kabel eller frekvensband – för det krävs komprimering.

Thomas Eriksson, professor och viceprefekt vid institutionen för signaler och system på Chalmers tekniska högskola, berättar att digitaliseringen gjort det möjligt att beskriva signalen på nya sätt – och drastiskt reducera mängden information som behöver skickas.

– Typiska data innehåller mönster som upprepas. Kan man hitta mönstren är det möjligt att spara och tal är väldigt tacksamt, säger Thomas Eriksson.

Allt börjar med digitalisering

Första steget på vägen för att skicka tal eller musik effektivt är sampling och kvantisering – omvandling från analogt till digitalt. Två faktorer avgör ljudkvaliteten – samplingsfrekvensen och bitdjupet. Sampling innebär att man tar en ögonblicksbild av nivån – amplituden – på den analoga signalen. Bitdjupet, eller upplösningen, är antalet bitar varje sampel innehåller. Fler bitar gör det möjligt att beskriva amplituden mer exakt och man får en signal med mer dynamik och mindre distorsion – 8 bitar ger exempelvis 256 olika nivåer och varje extra bit ger en fördubbling av antalet.

Den analoga signalen går att likna vid en skidbacke. Mäter man tillräckligt exakt har en åkare alltid förflyttat sig till en ny höjdnivå hur kort tid som än passerar. Den digitala signalen är som en trappa nedför samma berg – antalet steg är definierat exakt och man står vid varje tidpunkt på en av dessa nivåer – det finns ingen möjlighet att beskriva ett läge mellan två steg. Skillnaden i höjd mellan skidåkaren och det trappsteg som ligger närmast i nivå kallas kvantiseringsfel. Med hög upplösning – många databitar i varje sampel – minskar felen.

Samplingsfrekvensen bestämmer bandbredden – alltså skillnaden mellan de högsta och de lägsta frekvenserna i ljudsignalen. För musik vill man fånga upp alla frekvenser – upp till dryga 20 kHz – som örat kan höra medan ett telefonsamtal traditionellt begränsas till det som ryms mellan cirka 300 och 3 400 Hz. Sambandet mellan samplingsfrekvens och bandbredd beskrivs av en formel som kallas Nyquists lag. Namnet kommer från den svenske vetenskapsmannen Harry Nyquist som verkade vid bland annat AT&T och Bell Labs. Nyquists forskning innehåller mängder av matematik, men det man behöver känna till om hans lag är väldigt enkelt – för att digitalisera ljud av en viss frekvens måste samplingsfrekvensen vara minst dubbelt så hög.

Som exempel kan vi ta en mycket vanlig kombination av upplösning och samplingsfrekvens: 44,1 kHz och 16 bitar. Philips och Sony enades om siffrorna redan 1980 när standarden för CD-skivor spikades och samma specifikationer ligger till grund för de flesta digitala musikformat – både nedladdade och strömmande. Enligt Nyquists lag räcker 44,1 kHz för ljud upp till 22,05 kHz – med andra ord täcker det med god marginal in de frekvenser örat kan höra samtidigt som 16 bitar per sampel ger bra dynamik utan hörbara kvantiseringsfel. För telefonsamtal, där man klipper bort alla frekvenser ovanför cirka 3,4 kHz, räcker det med 8 kHz samplingsfrekvens och 8 bitars bitdjup.

Digitalt ljud utan komprimering brukar kallas PCM (pulskodsmodulerat) eftersom amplituden i varje sampel kodas till ett numeriskt värde. Det finns fler sätt att digitalisera ljud – till exempel pulsdensitetsmodulation där amplituden beskrivs av proportionerna mellan ettor och nollor i en dataström – men PCM är den helt dominerande lösningen och används för både tal och musik i mobilen. Det är enkelt att räkna ut hur mycket data som krävs för PCM-ljud. Samplingsfrekvensen × bitdjupet × antalet kanaler ger antalet bitar per sekund. För CD-ljud blir det strax under 1,5 Mbit/s medan okomprimerat tal i telefonkvalitet kräver 64 kbit/s. Jämfört med de bredbandshastigheter vi använder idag låter det inte så mycket, men tack vare begränsningarna som fanns när tekniken utvecklades har vi idag standarder som klarar att minska datamängderna med omkring 90 procent utan att kvaliteten försämras alltför mycket.

Så funkar komprimering

När ljudet omvandlats från analog till digital form öppnas en hel verktygslåda av möjligheter för att få ned datamängderna. Komprimeringen kan ske på två sätt – destruktivt eller icke-destruktivt. Den icke-destruktiva komprimeringen fungerar ungefär som en zip-fil i datorn – alla onödiga upprepningar räknas bort och beskrivs på ett mer effektivt sätt. När filerna packas upp igen är informationen helt identisk med originalet. Med digitalt ljud kan man ofta uppnå det genom att lagra förändringen från ett sampel till nästa istället för att lagra samtliga värden. Om en signal ökar i amplitud – i exemplet från värdet 128 – är det effektivare att lagra ”128, 1, 1, 1, 1” än ”128, 129, 130, 131, 132”. För att ytterligare öka effektiviteten kan man låta komprimeringen skapa en matematisk modell som gissar värdet på nästa sampel – och bara lagra skillnaden mellan gissningen och det verkliga värdet. Eftersom ljud följer fysiska lagar och sällan är helt slumpmässigt går det att göra väldig bra sådana modeller.

Icke-destruktiv komprimering används sällan för tal. För musik finns det däremot flera så kallade förlustfria format där ljudkvaliteten blir helt identisk med originalet på CD – något som uppskattas av audiofiler. FLAC och Apple Lossless är exempel som båda klarar att krympa filerna till ungefär halva storleken – ett fullängdsalbum landar på 350 megabyte istället för 700 megabyte.

När det krävs ännu mer komprimering – till exempel för att maxa mängden musik i mobilen eller för att klara fler telefonsamtal i luften samtidigt – går det inte längre att återskapa en identisk kopia av det ursprungliga digitala ljudet. En stor del av informationen måste kastas bort och går förlorad – därav namnet destruktiv komprimering. Nästan allt digitalt innehåll vi konsumerar har gått igenom någon form av destruktiv komprimering – med CD-skivor och vissa typer av digitalt bioljud som två sällsynta undantag. Trots det märker vi inte mycket av komprimeringen. Anledningen är att man inte kastar bort vad som helst – utan noga väljer ut de bitar som vi saknar minst. Ljudformat med destruktiv komprimering – till exempel MP3, AAC eller AMR – innehåller avancerade modeller för hur hörseln fungerar och jämfört med okomprimerad PCM eller FLAC är inte målsättningen att återskapa ljudvågorna exakt som de ser ut rent matematiskt – utan som de låter för en lyssnare.

– Sinnena är olika känsliga för olika typer av störningar, berättar Thomas Eriksson. Örat tolererar distorsion på vissa frekvenser och med vissa mönster mycket bättre än andra.

Forskningsområdet heter psykoakustik – hur vi uppfattar och upplever ljud. Den destruktiva komprimeringen drar särskilt stor nytta av ett fenomen som kallas maskering. Olika kombinationer av ljud lurar örat, så att vi bara uppfattar exempelvis det starkaste ljudet, ljudet med lägst frekvens eller ljudet som kommer först i tid – resten går att ta bort utan att det hörs någon skillnad. Så hur går det till att ”kasta bort” ett ljud? Komprimeringen använder matematiska metoder som snabb fouriertransform eller diskret cosinustransform för att dela upp ljudet i ett antal frekvensband – från två upp till omkring 1 000 beroende på algoritm. Sedan hackas den frekvensindelade signalen upp i tidsenheter som kallas frames. Med hjälp av den psykoakustiska modellen värderas varje frame efter hur tydligt man kan höra den. En värdefull frame blir tilldelad fler databitar och spelas upp mer detaljrikt när man lyssnar på resultatet medan lägre värderade frames – som innehåller frekvenser som få hör eller som maskeras av andra ljud – lagras med sämre upplösning. Tekniken är så effektiv att många lyssnare misslyckas med att skilja komprimerad musik från originalet i blindtester redan vid 128 kbit/s – mer än 90 procents komprimering.

När det gäller samtal går det att uppnå ännu högre komprimeringsgrader. Thomas Eriksson berättar att det finns algoritmer som klarar att överföra tal ända ned till 1,2 kbit/s – knappa 2 procent av den okomprimerade signalen.

– Talkomprimering är väldigt specifikt byggd för att komprimera just tal. Algoritmerna innehåller en extensiv modell av vad en röst kan säga, så det fungerar inte alls bra att spela musik genom en sådan modell.

Talkomprimeringen kommer alltså ned till väldigt små datamängder genom att inte bara reducera bort sådant som örat inte uppfattar, utan också de ljud som inte ingår i mänskligt tal. Jämfört med musik består ett samtal dessutom av en ganska stor del tystnad – som naturligtvis går att komprimera oerhört hårt utan att något värdefullt går förlorat. Att låta det bli helt tyst i luren är dock ingen bra idé – då tror vi att det är något fel på förbindelsen. Istället använder talkomprimeringen så kallat ”comfort noise” – syntetiskt bakgrundsbrus. Det innebär att när motparten är tyst skapar din mobil ett brus som matchar bakgrundsljudet hos den du talar med tillräckligt väl för att du ska uppleva att ni har förbindelse samtidigt som väldigt lite data behöver skickas.

Vid komprimering av musik kan man låta en dator gå igenom låtarna flera varv för att hitta de smartaste sätten att få ned datamängden. Genom att analysera lite längre partier går det också att identifiera maskerade ljud med större precision. När det gäller tal är de möjligheterna väldigt begränsade – komprimeringen måste ske i realtid och med så liten fördröjning som möjligt.

– Det krävs fördröjning för att kunna hitta mönstren och ju mer fördröjning, ju mer kan man komprimera. Men i ett samtal tolereras bara runt 100 millisekunder innan man börjar bli irriterad, säger Thomas Karlsson.

Allt är inte digitalt

Den digitala tekniken har gjort det möjligt att bygga mobilnät där miljoner användare kan prata med varandra samtidigt, köpa musik och lyssna på radiokanaler. Men utan analoga delar skulle det inte fungera. Mobilerna har högtalare, mikrofoner och analoga förstärkare som måste lösa samma uppgifter som när telefonin uppfanns för över 100 år sedan – att översätta mellan elektriska signaler och rörelser i luften.

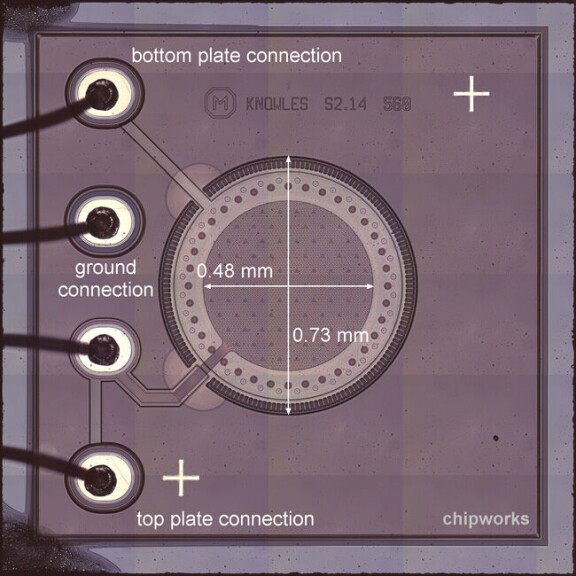

Bland de analoga delarna har den mest spännande utvecklingen skett när det gäller mobilens mikrofoner. Skrymmande komponenter som stora membran och rörliga spolar har ersatts av komponenter byggda med en teknik som kallas MEMS – mikroelektromekaniska system. Det innebär att man bygger små ”maskiner” med rörliga delar i en skala och med tillverkningsmetoder som liknar produktionen av integrerade kretsar. Mobilmikrofoner från tillverkare som Knowles och Infineon består av två delar – en analogdel tillverkad i MEMS-teknik och en integrerad hårdvara (ASIC) som omvandlar det som mikrofonen hör till en digital signal som går vidare till mobilens systemchip. Hela enheten tar bara upp ett par kvadratmillimeter och de analoga signalvägarna mäts i mikrometer – med andra ord små kabelförluster och liten exponering för brus från andra komponenter. Bluetooth-headset innehåller samma typ av mikrofoner, medan sladdheadset (med undantag för modeller som kopplas in med Apples Lightning-kontakt) har mer traditionella lösningar och använder de separata omvandlare mellan analog och digital signal som servar mobilens 3,5-millimeterskontakt.

Högre kvalitet – även för tal

Snabbare mobilnät med HSPA och LTE har minskat behovet av att uppfinna ännu mer komprimeringsteknik för tal eller musik och utrymmet används istället för att höja ljudkvaliteten. De stora musiktjänsterna – till exempel Spotify och Itunes – har mer än fördubblat bithastigheten och ligger nu bara snäppet under förlustfri komprimering i kvalitet. Samtalsljudet har inte fått uppleva samma snabba utveckling. Tröghet när det gäller standardisering har medfört att de allra flesta samtalen rings med samma frekvensomfång som på bakelittelefonernas tid och kodas med den 15 år gamla AMR-komprimeringen. Först under det senaste året har samtalskvaliteten i mobilnätet fått ett rejält lyft genom en teknik som kallas HD voice.

– Med HD voice blir samtalen tydligare, upplevs som mer naturliga och skapar en känsla av närhet med den man talar med. En markant skillnad mot ett ”vanligt” röstsamtal är att HD voice reducerar bort störande bakgrundsbrus på ett bättre sätt, berättar Nicholas Rundbom, pressansvarig på Telia.

HD voice introducerar ett nytt ljudformat i standarden för vanliga röstsamtal – AMR Wideband. Samplingsfrekvensen är fördubblad till 16 kHz vilket gör att en betydligt större del av röstens ljud följer med. Dubbla bandbredden jämfört med vanliga röstsamtal redan vid 12,54 kbit/s och maximal kvalitet när mobilnätet klarar 23,85 kbit/s. AMR Wideband kan alltså leverera bättre ljud även i GSM-nät, men används främst i 3G-näten.

Utrullningen i Sverige avslutades under hösten 2014 när Telenor slog på funktionen i sitt nät – övriga operatörer var igång under våren och sommaren. Det fungerar dock inte för alla samtal – även om rätt mobiler används.

Kamran Alemdar, PR- och informationschef för Tre, berättar att det är en utmaning att få tjänsten att fungera mellan olika infrastrukturer och operatörer.

– Samtal i HD mellan olika operatörer kan komma att bli verklighet inom inte en alltför lång framtid, men jag kan inte ge någon exakt tidsram tyvärr.

Vägen fram till fungerande HD voice har varit lång, men det finns lösningar på väg som ger ännu bättre ljud. Flera operatörer i USA och Asien har redan kört igång med röstsamtal över 4G-näten – så kallad Voice over LTE (VOLTE). I Sverige har Tele2 testat tekniken. Den högre kapaciteten med LTE gör att det finns utrymme för att öka bandbredden ytterligare genom att byta ut AMR Wideband mot ljudformatet Opus eller en specialversion av AAC med extra låga fördröjningar. Standardiseringen tar dock väldigt lång tid, och vill man ha maximal samtalskvalitet redan idag är ofta IP-telefonitjänster det bästa alternativet. Appar som Skype, Google Hangouts eller Apple Facetime ligger redan idag steget före HD voice – förutsatt att du har bra 4G-täckning. En annan fördel med IP-telefoni är att du inte bara kan ringa andra mobiler hos din egen operatör – du kan ringa datorer, surfplattor eller mobiler var som helst i världen. Så länge motparten använder samma app och har tillräckligt snabb uppkoppling.

Fakta: Ljudformat

AIFF (Audio Interchange File Format)

• Komprimering: ingen

• Mobilstöd: Ios. Android via app.

• Användningsområden: ljudinspelning

Introducerat 1988 och ett av de äldsta filformat som fortfarande används. Standardformatet för okomprimerat ljud i Apple-enheter. Används främst vid inspelning och redigering och kan sedan konverteras till exempelvis ALAC eller AAC för effektivare lagring.

ALAC (Apple Lossless Audio Codec)

• Komprimering: icke-destruktiv

• Mobilstöd: Ios. Android och Windows Phone via app.

• Användningsområden: musik

Leder till ungefär lika stora besparingar som FLAC, men har begränsat stöd utanför Ios-världen. Det finns Androidappar som kan spela formatet – till exempel Rocket Player.

AMR (Adaptive Multi-Rate audio codec)

• Komprimering: destruktiv

• Mobilstöd: ja

• Användningsområden: telefoni

AMR ersatte 1999 GSM Full Rate som standardformatet för tal i mobilnäten. AMR anpassar bithastigheten i åtta steg efter kvaliteten på uppkopplingen och ger bra kvalitet från 7,4 kbit/s, men fungerar med så lite som 4,75 kbit/s. AMR används främst för vanlig samtalskvalitet med 8 kHz samplingsfrekvens, men det finns även en bredbandig variant – AMR-WB – som används för HD voice.

FLAC (Free Lossless Audio Codec)

• Komprimering: icke-destruktiv

• Mobilstöd: Android. Ios och Windows Phone via app.

• Användningsområden: musik

Ett öppet format som reducerar musikfiler till omkring halva storleken utan att någon information går förlorad. Vanligt förekommande format i kvalitetsinriktade musikbutiker på nätet.

MP3 (MPEG Audio Layer 3)

• Komprimering: destruktiv

• Mobilstöd: Android, Ios och Windows Phone

• Användningsområden: musik, poddsändningar, ljudböcker, strömmande

Formatet dök upp i datorprogram och digitala musikspelare under slutet av 1990-talet. Privat- och piratkopiering gjorde formatet populärt, men sedan kopieringsskydden fasats ut dominerar MP3 tillsammans med AAC även marknaden för kommersiell musiknedladdning. Formatets högsta bithastighet – 320 kbit/s – är svår att skilja från ett okomprimerat original och utgör idag branschstandard.

Vorbis

• Komprimering: destruktiv

• Mobilstöd: Android. Ios och Windows Phone via app.

• Användningsområden: musik, strömmande

Licensfritt alternativ till MP3 och AAC. Anses, i likhet med AAC, ge bättre ljudkvalitet än MP3 vid låga bithastigheter. En av de största användarna av Vorbis är Spotify som strömmar musik i formatet med 96, 160 eller 320 kbit/s.

WAV (Waveform Audio File Format)

• Komprimering: ingen

• Mobilstöd: Android, Ios och Windows Phone

• Användningsområden: ljudinspelning

Standardformatet för okomprimerat ljud på Windows-datorer. Används på samma sätt som AIFF.

WMA (Windows Media Audio)

• Komprimering: destruktiv

• Mobilstöd: Windows Phone. Android och Ios via app.

• Användningsområden: musik

Microsoft-format som ungefär motsvarar MP3, AAC eller Vorbis. Används sparsamt utanför Microsofts ekosystem.

WMA Lossless

• Komprimering: icke-destruktiv

• Mobilstöd: Windows Phone. Android via app.

• Användningsområden: musik

Microsofts svar på FLAC och ALAC.

Ljudets varumärken

Tillverkarna sätter gärna olika brands och kvalitetsstämplar på mobilernas ljudfunktioner. Vad innebär beteckningarna?

Aptx

En uppsättning format för ljudkodning som utvecklas av CSR (Cambridge Silicon Radio) sedan 1980-talet. Från början ett professionellt format för digitala trådlösa mikrofoner. Syftet med Aptx i mobilen är att höja ljudkvaliteten i trådlösa hörlurar och högtalare. Aptx ersätter standardkodningen i bluetooth – förutsatt att både mobil och hörlurar eller högtalare har stöd för tekniken. Aptx finns främst i Blackberry- och Androidmobiler – till exempel flertalet lurar från HTC, Samsung och Sony.

Dolby Digital Plus

Dolby-loggan var vanlig på Sony Walkman och andra kassettspelare under 80- och 90-talet. Då handlade det om analog brusreducering för att få banden att låta lite bättre. Dolby Digital Plus i mobilen är smarta funktioner för filmljud. Tekniken gör det möjligt att lagra surroundljud med lägre bithastighet – viket är värdefullt vid strömmande ljud – och att optimera uppspelningen för vanliga hörlurar eller mobilhögtalare. Genom att lägga på fördröjningar och fasförskjutningar på de olika kanalerna går det att mixa ned filmljudet till stereo och samtidigt behålla surroundupplevelsen.

SRS Mobile

Motsvarighet till mobilfunktionerna i Dolby Digital Plus från konkurrenten DTS. Ger surroundljud i stereolurar och innehåller equalizerfunktioner som lyfter fram dialogen eller kompenserar för ojämn frekvensgång i små högtalare.

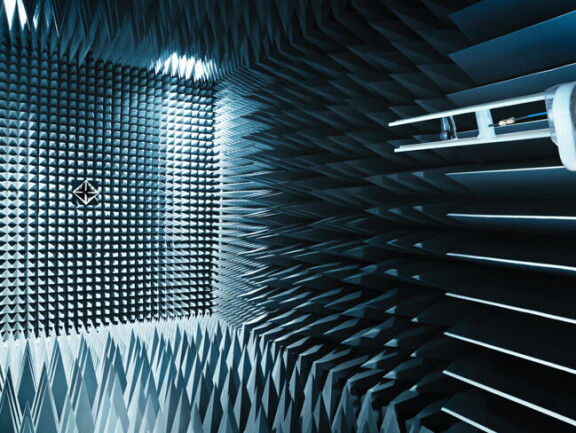

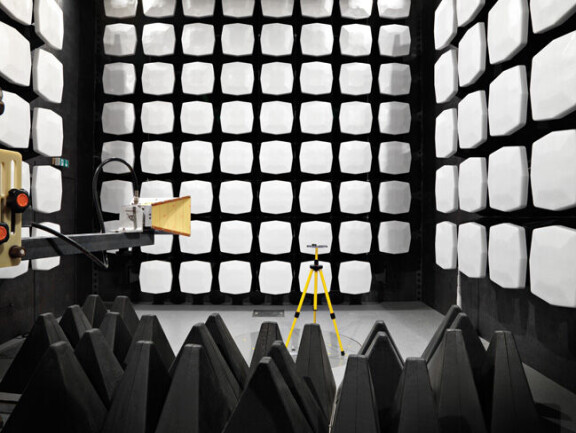

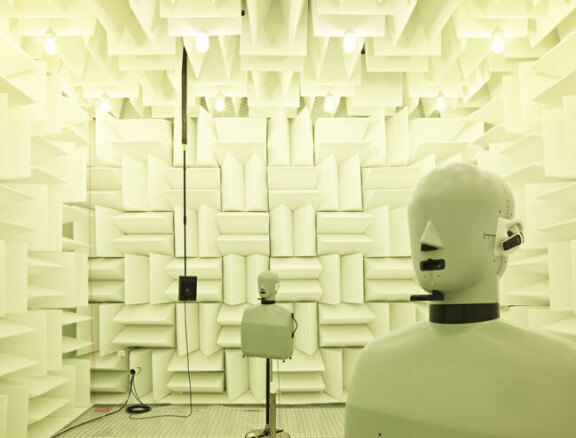

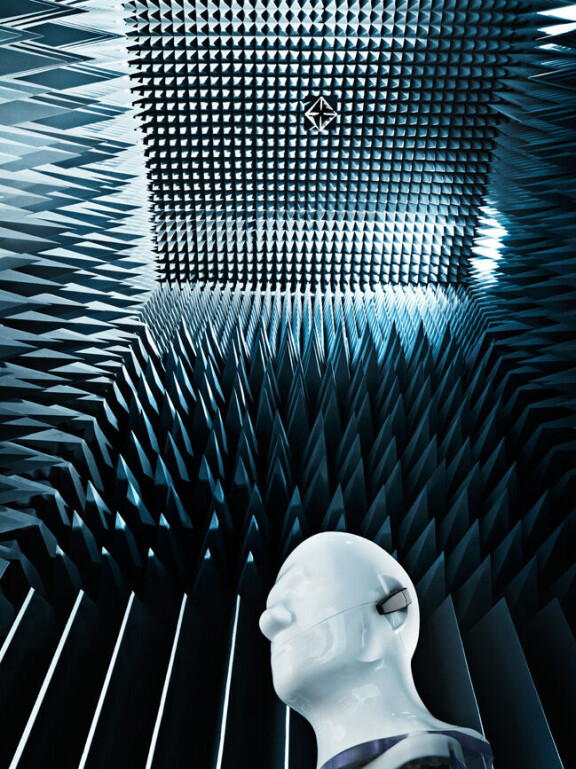

Så testas mikrofoner

Utvecklingen av headset och mikrofoner för mobiler handlar inte bara om beräkningar och digital teknik. Det krävs många praktiska tester och mätningar av hur ljudet beter sig i den analoga världen. Mobil besökte i somras GN Research Lab i Köpenhamn – där bland annat Jabras headset utvecklas. I laboratoriet testas produkterna i olika miljöer – från helt tysta och ekofria kammare till rum som simulerar hem, kontor eller bilar. Det ger kunskap om hur mikrofonerna fungerar under verkliga förhållanden och hur förändringar av designen – eller mjukvaran – påverkar ljudkvaliteten.